人工智能(AI)技术的突飞猛进引发了对计算能力的巨大需求,进而凸显了AI服务器电源的关键作用。

本文将从多个维度剖析AI服务器电源的发展现状,包括其重要性、技术特点、市场需求以及行业竞争。

01 AI服务器电源的需求趋势

AI技术的精进导致电力消耗剧增。据Artificial Intelligence Index Report 2023统计,各类先进AI模型如DeepMind Gopher、Hugging Face BLOOM、OpenAI GPT-3、meta OPT的单次训练耗电量分别高达1066MWh、433MWh、1287MWh和324MWh。

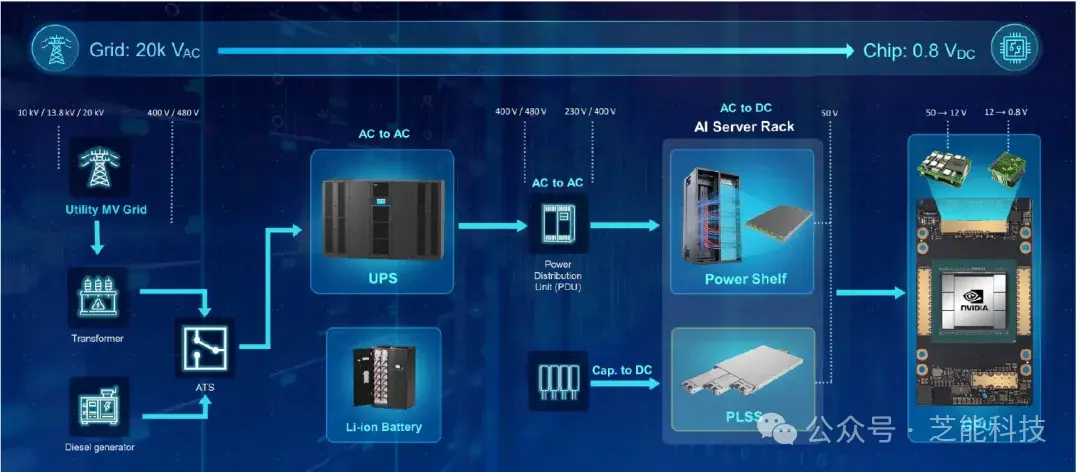

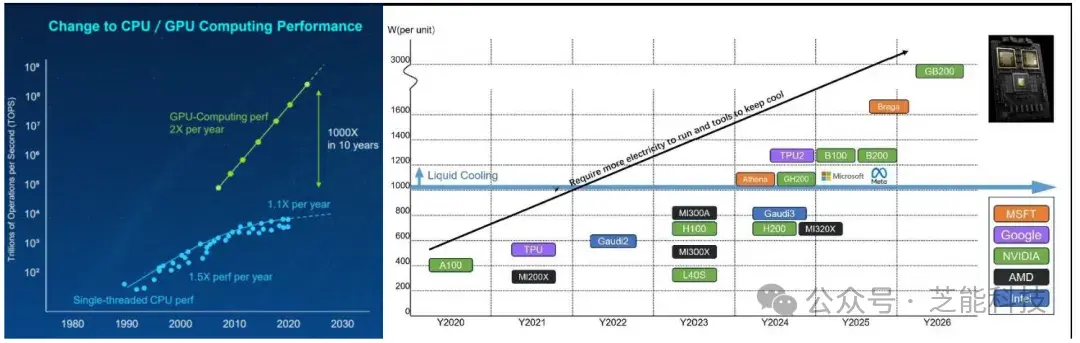

国际能源署(IEA)的数据指出,2023年NVIDIA芯片的电力消耗已达7.3TWh,预估至2026年,这一数字将飙升至2023年的十倍。在电力需求日益增长的情境下,高效能的服务器电源变得至关重要。相较于传统服务器电源96%的转换效率,AI服务器电源需达到97.5%-98%的高标准,以降低能量损耗并支撑更高功率密度的GPU。

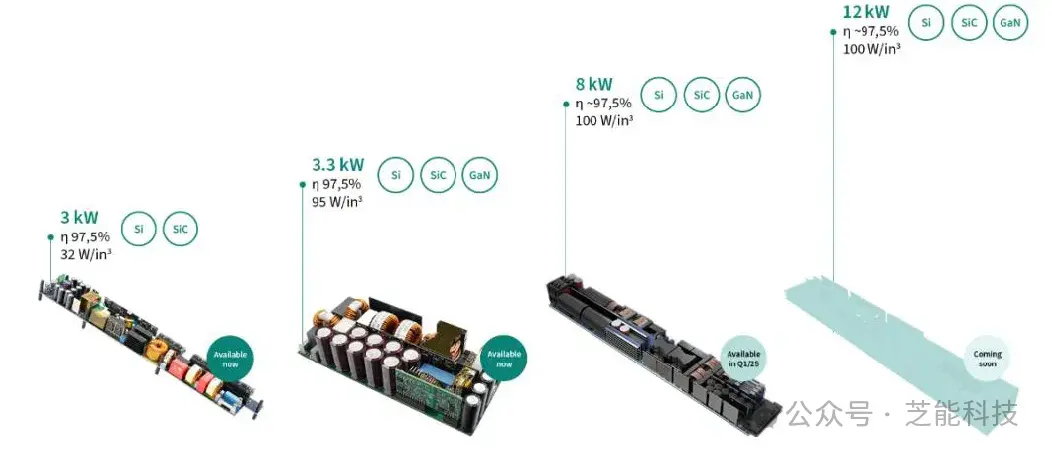

AI模型与GPU技术的迭代促使AI服务器电源的功率密度不断提升。以H100服务器机架为例,10.2kW的功率需要配备19.8kW的电源;而NVL72机架的120kW功率则要求198kW的电源模块。AI服务器电源的功率密度可达100W/立方英寸,远超普通服务器电源的50W/立方英寸。

02 AI服务器电源的技术架构与特性

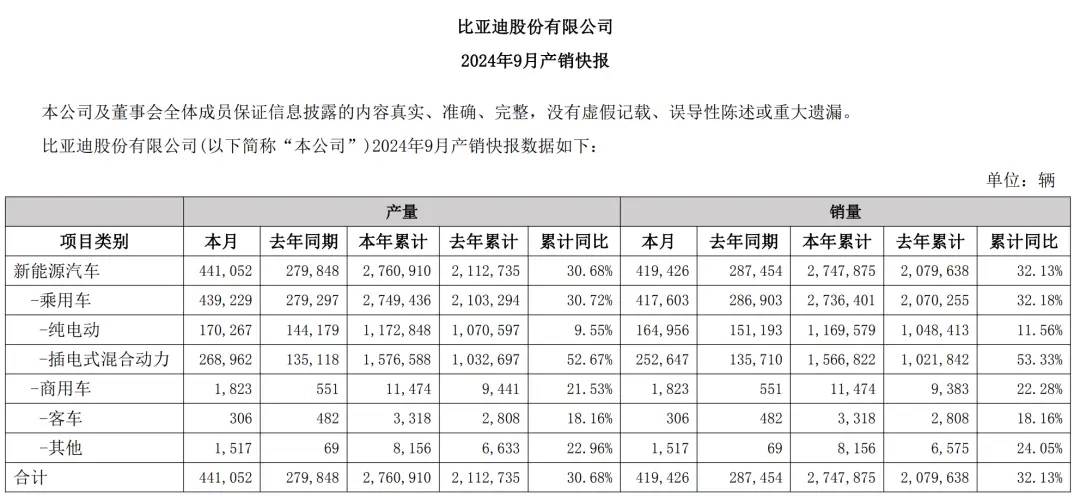

AI服务器电源的架构由UPS、AC/DC和DC/DC三个层级构成,各司其职确保电力供应的连续性和稳定性。

● UPS:在电网中断时提供临时电力,保护数据免受损失。

● AC/DC:将电网的交流电转换为适合服务器使用的50V直流电。

● DC/DC:进一步将50V直流电降至芯片可接受的0.8V。

AC/DC电源模块包含电源模块(PSU)和电源管理控制器(PMC),例如,NVL72服务器机架需配置6组电源架,总计36个模块,总功率198kW。DC/DC模块则要求紧密贴合负载,以减少供电网络的损耗。

AI服务器电源的功率密度目标是180W/立方英寸,这对散热技术提出了新的挑战。液冷技术因能有效提升温控性能,正逐步取代传统的风冷方案。

预计2024/25年,AI服务器电源的AC/DC和DC/DC需求将分别达到10.2GW/11.8GW和3GW/4GW。市场规模有望在2025年扩大至156亿至272亿元。当前市场由台系厂商引领,但国产品牌正在奋起直追,有望凭借持续的研发投入和技术积累,在未来占据一席之地。

小结

AI服务器电源作为AI技术发展的基石,其技术创新和市场拓展将伴随AI领域的持续繁荣。面对未来,国产品牌需抓住机遇,迎接挑战,共同推动AI服务器电源行业的进步与创新。

来源:芝能汽车